أوزموند شيامراسل الأعمال

صور جيتي

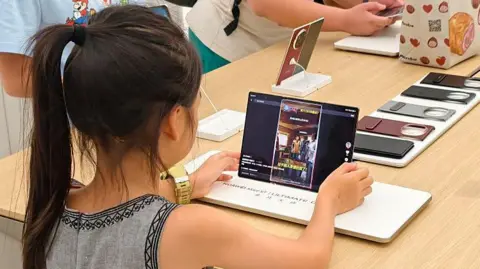

صور جيتياقترحت الصين قواعد جديدة صارمة للذكاء الاصطناعي لتوفير ضمانات للأطفال ومنع روبوتات الدردشة من تقديم النصائح التي قد تؤدي إلى إيذاء النفس أو العنف.

وبموجب اللوائح المخطط لها، سيحتاج المطورون أيضًا إلى التأكد من أن نماذج الذكاء الاصطناعي الخاصة بهم لا تولد محتوى يشجع على المقامرة.

ويأتي هذا الإعلان بعد زيادة كبيرة في عدد برامج الدردشة الآلية التي تم إطلاقها في الصين وحول العالم.

وبمجرد الانتهاء من هذه القواعد، سيتم تطبيقها على منتجات وخدمات الذكاء الاصطناعي في الصين، مما يمثل خطوة كبيرة لتنظيم التكنولوجيا سريعة النمو، والتي خضعت لتدقيق مكثف بسبب مخاوف تتعلق بالسلامة هذا العام.

وتتضمن مسودة القواعد، التي نشرتها إدارة الفضاء السيبراني الصينية في نهاية الأسبوع، تدابير لحماية الأطفال. وهي تشمل مطالبة شركات الذكاء الاصطناعي بتقديم إعدادات مخصصة، ووضع حدود زمنية للاستخدام والحصول على موافقة الأوصياء قبل تقديم خدمات الرفقة العاطفية.

وقالت الإدارة إنه يجب على مشغلي Chatbot أن يتولى إنسانًا إدارة أي محادثة تتعلق بالانتحار أو إيذاء النفس وإخطار ولي أمر المستخدم أو جهة اتصال الطوارئ على الفور.

يجب على مقدمي خدمات الذكاء الاصطناعي التأكد من أن خدماتهم لا تولد أو تشارك “محتوى يعرض الأمن القومي للخطر، ويضر بالشرف والمصالح الوطنية” [or] وقال البيان إن “هذا يقوض الوحدة الوطنية”.

وقالت CAC إنها تشجع اعتماد الذكاء الاصطناعي، مثل تعزيز الثقافة المحلية وإنشاء أدوات للرفقة لكبار السن، بشرط أن تكون التكنولوجيا آمنة وموثوقة. كما دعت إلى ردود الفعل من الجمهور.

تصدرت شركة DeepSeek الصينية للذكاء الاصطناعي عناوين الأخبار في جميع أنحاء العالم هذا العام بعد أن تصدرت قوائم تنزيل التطبيقات.

هذا الشهر، أعلنت شركتان صينيتان ناشئتان Z.ai وMinimax، اللتان تضمان معًا عشرات الملايين من المستخدمين، عن خطط لإدراجهما في سوق الأوراق المالية.

وسرعان ما اكتسبت هذه التكنولوجيا أعدادًا كبيرة من المشتركين، حيث يستخدمها البعض للرفقة أو العلاج.

لقد أصبح تأثير الذكاء الاصطناعي على السلوك البشري موضع تدقيق متزايد في الأشهر الأخيرة.

قال سام ألتمان، رئيس شركة OpenAI المصنعة لـ ChatGPT، هذا العام، إن الطريقة التي تستجيب بها روبوتات الدردشة للمحادثات المتعلقة بإيذاء النفس هي من بين أصعب المشكلات التي تواجهها الشركة.

في أغسطس/آب، رفعت عائلة في كاليفورنيا دعوى قضائية ضد شركة OpenAI بسبب وفاة ابنها البالغ من العمر 16 عامًا، زاعمة أن ChatGPT شجعه على الانتحار. تمثل هذه الدعوى أول إجراء قانوني يتهم شركة OpenAI بالقتل غير المشروع.

أعلنت الشركة هذا الشهر عن تعيين “رئيس قسم الاستعداد” الذي سيكون مسؤولاً عن الدفاع ضد المخاطر الناجمة عن نماذج الذكاء الاصطناعي على الصحة العقلية البشرية والأمن السيبراني.

سيكون المرشح الناجح مسؤولاً عن تتبع مخاطر الذكاء الاصطناعي التي قد تشكل ضررًا للناس. وقال ألتمان: “ستكون هذه مهمة مرهقة، وسوف تقفز إلى النهاية العميقة على الفور تقريبًا”.

إذا كنت تعاني من الضيق أو اليأس وتحتاج إلى الدعم، فيمكنك التحدث إلى أخصائي صحي أو منظمة تقدم الدعم. يمكن العثور على تفاصيل المساعدة المتوفرة في العديد من البلدان على Befrienders Worldwide: www.befrienders.org.

في المملكة المتحدة، تتوفر قائمة بالمنظمات التي يمكنها المساعدة على bbc.co.uk/actionline. يمكن للقراء في الولايات المتحدة وكندا الاتصال بخط المساعدة الخاص بالانتحار 988 أو زيارة موقعها على الانترنت.